Noong 2016, ang computer scientist na si Andrew Ng kumpara nag-aalala tungkol sa superintelligent AI hanggang sa pag-aalala tungkol sa sobrang populasyon sa Mars. Hindi pa nga tayo napadpad sa planeta, sabi niya, kaya bakit sa Earth tayo dapat magsimulang mag-freaking out? Ang makabagong AI ay maaaring gumawa ng ilang mga nakakaakit na trick, sigurado, ngunit ito ay isang zillion milya ang layo mula sa pagpapakita ng isang umiiral na banta sa sangkatauhan.

Ang problema sa linya ng pangangatwiran na iyon ay nabigo itong isaalang-alang kung gaano katagal ang maaari nating lutasin kung ano ang tinatawag ng mga mananaliksik ng AI na "problema sa pagkakahanay", at kung ano ang tinatawag ng mga manonood na tulad ko na "some pretty freaky shit". Mayroong maraming mga ideya na kailangan kong i-zoom upang ipaliwanag kung bakit, ngunit ang mga pangunahing punto ay: Ang Superintelligent AI ay maaaring lumitaw nang napakabilis kung magdidisenyo tayo ng AI na mahusay sa pagdidisenyo ng AI, ang produkto ng gayong recursive intelligence. Ang pagsabog ay maaaring may mga layunin na hindi umaayon sa ating sarili, at walang kaunting dahilan para isipin na hahayaan tayo nitong i-flick ang off switch.

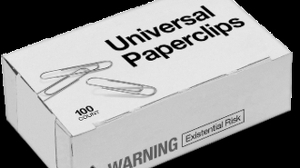

Tulad ng gustong sabihin ng mga taong tulad ng pilosopo na si Nick Bostrom, ang alalahanin ay hindi pagmamalupit - ito ay kakayahan. Siya ang gumawa ng eksperimento sa pag-iisip na iyon tungkol sa isang AI na naglalayong gawing mga paperclip ang buong uniberso, isang pantasyang maaari at dapat mong isabuhay. itong libreng online na i-click ang mga ito. Ang isang partikular na maanghang na bahagi ng apocalyptic meatball ay na sa pamamagitan ng pagbibigay ng AI sa halos literal na anumang layunin, malamang na hindi rin namin sinasadyang bigyan ito ng ilang mga instrumental na layunin, tulad ng pag-maximize sa sarili nitong kapangyarihan sa pag-compute o pag-alis ng anumang ahente na maaaring makahadlang.